What is SillyTavern? | docs.ST.app

SillyTavern - LLM Frontend for Power Users

docs.sillytavern.app

SillyTavern은 AI 캐릭터와의 인터랙티브 채팅을 위한 프론트엔드 애플리케이션으로 다양한 대형 언어 모델(LLM) API를 하나의 통합된 인터페이스로 제공하는 강력한 사용자 인터페이스을 제공합니다.

1. 가상 캐릭터와의 인터랙션

- 역할극(Roleplay, RP): 다양한 가상의 캐릭터를 생성하고, 해당 캐릭터와 대화하면서 이야기(스토리)를 만들어갈 수 있습니다.

- 텍스트 기반 RPG: 게임 스타일의 대화를 통해 자신만의 모험을 즐길 수 있습니다.

- 창작 및 소설 작업: AI와 협업하여 캐릭터와 스토리를 개발하거나 영감을 얻는 데 사용할 수 있습니다.

2. 개인 비서 및 지능형 어시스턴트

- 일정 관리 및 생산성 도우미: AI 캐릭터를 개인 비서로 설정하여 일정 관리, 목표 추적 등을 도울 수 있습니다.

- 아이디어 브레인스토밍: 프로젝트 아이디어를 정리하거나 창의적인 글쓰기 작업을 도울 수 있습니다.

3. 심리적 지원 및 감정적 교류

- 감정적인 대화 상대: 외로움을 해소하거나 감정을 나눌 수 있는 가상 친구로 활용할 수 있습니다.

- 정신 건강 관리: 스트레스 해소를 위한 대화, 일기 작성 도우미 등으로 활용 가능하지만, 전문적인 상담이 필요한 경우 심리 전문가의 도움을 받는 것이 좋습니다.

4. 언어 학습 및 교육

- 언어 연습: AI 캐릭터를 특정 언어(예: 영어)로 설정하여 자연스러운 대화를 연습할 수 있습니다.

- 교육적 질문: 역사, 과학, 철학 등 다양한 분야의 학습 보조 역할을 할 수 있습니다.

5. API 연결을 통한 확장

- LLM(Local Large Language Model)과 연결하여 활용 가능: LM Studio 등과 연동하여 로컬에서 실행되는 AI 모델과 연결해 비용을 절감하면서 AI 채팅을 활용할 수 있습니다.

- OpenAI 및 타사 API 연동: GPT-4, Claude, Mistral 등 다양한 AI 모델을 연결하여 원하는 성능을 조정할 수 있습니다.

그외 주요 기능:

- 다양한 LLM API 통합: SillyTavern은 KoboldAI/CPP, Horde, NovelAI, Ooba, Tabby, OpenAI, OpenRouter, Claude, Mistral 등 다양한 LLM API와 호환되어 사용자가 선호하는 모델을 선택하여 사용할 수 있습니다. GitHub

- 모바일 친화적 레이아웃: 모바일 기기에서도 최적화된 레이아웃을 제공하여, 언제 어디서나 편리하게 AI와 상호작용할 수 있습니다.

- 비주얼 노벨 모드: 비주얼 노벨 형식의 스토리텔링을 지원하여, 사용자에게 몰입감 있는 경험을 제공합니다.

- 이미지 생성 통합: Automatic1111 및 ComfyUI API를 통한 이미지 생성 기능을 통합하여, 텍스트와 이미지를 함께 활용한 풍부한 콘텐츠 제작이 가능합니다.

- 텍스트 음성 변환(TTS): 생성된 텍스트를 음성으로 변환하는 기능을 통해, 다양한 활용도를 제공합니다.

- 월드인포(설정집): 월드빌딩이나 설정집 기능을 통해, 스토리나 캐릭터의 배경 정보를 체계적으로 관리할 수 있습니다.

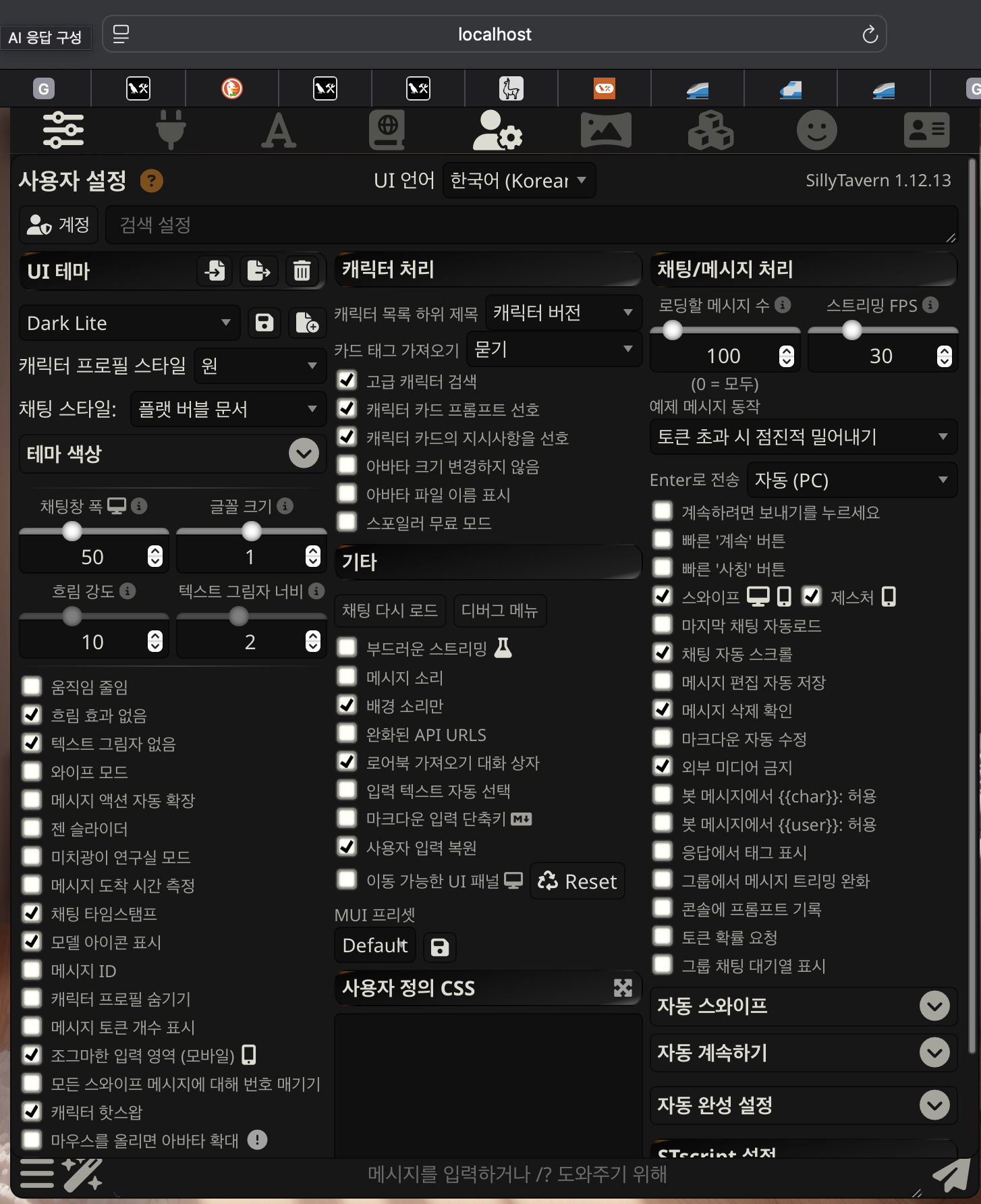

- 사용자 인터페이스 커스터마이징: 사용자 취향에 맞게 UI를 커스터마이징할 수 있어, 개인화된 환경을 제공합니다.

- 자동 번역: 다양한 언어로 작성된 텍스트를 자동으로 번역하여, 언어 장벽 없이 AI와 상호작용할 수 있습니다.

- 확장 가능한 기능: 서드파티 확장을 통해 기능을 무한히 확장할 수 있어, 사용자 요구에 맞게 기능을 추가할 수 있습니다.

설치

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 apps % git clone https://github.com/SillyTavern/SillyTavern && cd SillyTavern/docker

Cloning into 'SillyTavern'...

remote: Enumerating objects: 78144, done.

remote: Counting objects: 100% (360/360), done.

remote: Compressing objects: 100% (129/129), done.

remote: Total 78144 (delta 320), reused 232 (delta 231), pack-reused 77784 (from 5)

Receiving objects: 100% (78144/78144), 197.76 MiB | 19.19 MiB/s, done.

Resolving deltas: 100% (59022/59022), done.

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker % vi docker-compose.yml

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker % docker compose up -d

[+] Running 14/14

✔ sillytavern Pulled 11.7s

✔ 6c9d4d66fb49 Download complete 0.7s

✔ b86b3bdbfb80 Download complete 0.6s

✔ db031ee654d3 Download complete 3.1s

✔ d8be17ecdb59 Download complete 0.6s

✔ 75534657b842 Download complete 1.5s

✔ 3f3a575696f6 Download complete 0.5s

✔ 41da19f372e8 Download complete 2.0s

✔ ad74cd6d6a90 Download complete 0.6s

✔ d92ee845e944 Download complete 5.2s

✔ a28689883135 Download complete 0.5s

✔ 0abf37d84d8c Download complete 0.7s

✔ 5df77e2bb318 Download complete 0.5s

✔ 07d44b4c39be Download complete 4.0s

[+] Running 2/2

✔ Network docker_default Created 0.1s

✔ Container sillytavern Started 0.5s

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker %명령어:

git clone https://github.com/SillyTavern/SillyTavern && cd SillyTavern/docker

docker compose up -d

docker network inspect docker_default

에서 나온 gatway 값(172.21.0.1)을 아래 config.yaml 파일에 추가

#수정전

whitelist:

- ::1

- 127.0.0.1

# 수정후

whitelist:

- ::1

- 127.0.0.1

- 172.21.0.1

vi config/config.yaml

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker % docker network inspect docker_default

[

{

"Name": "docker_default",

"Id": "1f03dedac54da60a8cd7128fef2d4df1c49643c3de293e4a8f08a3b6f2d8d4e2",

"Created": "2025-03-18T13:56:35.361543547Z",

"Scope": "local",

"Driver": "bridge",

"EnableIPv6": false,

"IPAM": {

"Driver": "default",

"Options": null,

"Config": [

{

"Subnet": "172.21.0.0/16",

"Gateway": "172.21.0.1"

}

]

},

"Internal": false,

"Attachable": false,

"Ingress": false,

"ConfigFrom": {

"Network": ""

},

"ConfigOnly": false,

"Containers": {

"f88fa8a9d35f2c36d6cfb37f0df97eafdba780332c6cde268fd3a4be4b255d86": {

"Name": "sillytavern",

"EndpointID": "bce630ab07c73e9f4fa773b89c590fa8b23cada67ffab053f1cf73d669b5b830",

"MacAddress": "02:42:ac:15:00:02",

"IPv4Address": "172.21.0.2/16",

"IPv6Address": ""

}

},

"Options": {},

"Labels": {

"com.docker.compose.config-hash": "e7869dccd0af1856c658cbabad8f131128ffb37f03d845c4244677d8b7adea0c",

"com.docker.compose.network": "default",

"com.docker.compose.project": "docker",

"com.docker.compose.version": "2.32.4"

}

}

]

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker % vi config/config.yaml

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker % docker compose restart sillytavern

[+] Restarting 1/1

✔ Container sillytavern Started 0.3s

(ollama-deep-researcher) bhjo0930@Mac-mini-M4 docker %

http://localhost:8000

Local Ollama 연결 설정

'AI' 카테고리의 다른 글

| Open WebUI - 채팅 제어(파라메터) (0) | 2025.03.21 |

|---|---|

| LiteLLM - 다양한 LLM API 통합 관리 (0) | 2025.03.18 |

| Gartner 보고자료로 살펴보는 2025년 트렌드 변화 (0) | 2025.03.18 |

| Figma를 Bolt.new로 쉽게 옮기는 방법 (0) | 2025.03.16 |

| MCP: 모델 컨텍스트 프로토콜(Model Context Protocol) (0) | 2025.03.16 |

댓글